Левое полушарие - "идиот" из того трио, что мы изучаем. Оно является "цифровым устройством", отличается цикличностью при обработке информации и способно обеспечивать предельную скорость передачи приблизительно около 16 бит в секунду. Представляется, что такое ограничение в скорости передачи информации предопределено пределом скорости, с которой импульсы нейронов могут передвигаться непосредственно в самой нервной системе. Например, когда вы читаете эту страницу, волны различной интенсивности ударяются о сетчатку вашего глаза и преобразуются в электрические импульсы, которые затем посылаются по оптическому нерву в затылочную часть головы. Оттуда, после прохождения процедуры сортировки, эти импульсы отправляются в ассоциативную часть головного мозга, который расположен ближе к центру. В ассоциативной части происходит повторное воспроизведение, что мы обычно называем как запись (передача сообщений в письменной или печатной форме), а также осуществляет частичную интерпретацию, основываясь на факторах, которые уже заранее запрограммированы центром в систему. Для того чтобы все это произошло, необходимо 1/16 секунды. [c.166]

Алгоритм СОК основывается на соревновательном обучении без учителя. Он обеспечивает сохраняющее топологию отображение из пространства большой размерности в элементы карты. Элементы карты, или нейроны, обычно образуют двумерную решетку. Таким образом, это отображение является отображением пространства большой размерности на плоскость. Свойство сохранения топологии означает, что СОК распределяет сходные векторы входных данных по нейронам, т.е. точки, расположенные в пространстве входов близко друг к другу, отображаются на близко расположенные элементы СОК. Таким образом, СОК может служить как средством кластеризации, так и средством визуального представления данных большой размерности. [c.25]

В нашем первом примере мы использовали одномерную карту, для которой произвольно задали верхнюю границу, так как намеревались выяснить, каким образом будут кластеризоваться фонды при использовании десяти модельных векторов. Результатом было объединение 18 фондов в пять больших групп (так как фонды с легким отличием в окраске близки по характеристикам, в то время как фонды, окрашенные в более темные тона, сравнительно несхожи с окрашенными в более светлые). Во втором примере мы создали двумерную карту с помощью решетки модельных векторов. Мы произвольно определили предельную размерность решетки (6x4 нейрона). После 10 000 предъявлений обучающей последовательности с начальным коэффициентом обучения 0,5, уменьшавшимся линейно по мере предъявления данных, и второй фазы обучения, состоявшей из 100 000 предъявлений с начальным коэффициентом обучения около 0,2, мы получили карту следующего вида. Было использовано 24 модельных вектора, но только 11 из них притянули к себе хотя бы один из фондов. Выделение нейронов оттенками серого цвета позволяет нам более наглядно изобразить разграничение групп или зон на карте. Например, группа фондов, расположенных в левой части карты (MLD, AFR, ТЕМ, ЕМТ, LA , MSE), обособилась более четко по сравнению с другими. Фонды, расположенные сверху и снизу, отделены друг от друга двумя линиям нейронов. Фонд TDM соответствует единственному нейрону в нижнем углу карты, a S I располагается изолированно в середине. [c.85]

Слои этой гибридной двухслойной нейронной сети были обучены один за другим при помощи всего набора входных векторов данных за соответствующий год По окончании обучения набор данных по каждому из банков, представленный в виде 30-мерного входного вектора, был обработан при помощи этой сети и связан с выходным нейроном-победителем. Иными словами, каждый банк занял свое место на результирующей СОК. Близость расположения банков на данной карте указывает на схожесть их финансовых характеристик. [c.124]

Из рисунка видно, что по данным за 1988 г. развивающиеся рынки образуют три группы Корея и Тайвань — группу I в левой части карты, а Португалия и Филиппины — группу II, расположенную в ее правой части. Все остальные страны группируются в середине СОК. В 1990 г. можно различить четыре группы Индонезия, Индия и Малайзия попадают в группу I, а Чили, Мексика, Аргентина и Таиланд — в группу II. В 1993 г. подобных групп уже пять. На карте, отражающей данные на конец 1996 г., мы видим кластеризацию по всем нейронам от Чили, Колумбии и Филиппин слева до Венгрии, России, Индонезии и Марокко справа. По мере развития рынков значения и структура их показателей изменяются, вследствие чего они объединяются всякий раз в разные группы, как бы перескакивая из одного кластера в другой. [c.142]

Алгоритм СОК упорядочивает данные о свойствах объектов недвижимости, после чего соответствующие этим объектам нейроны (т.е. данные об их расположении на СОК) включаются в наборы данных ГИС. Каждый объект связывается с тем нейроном, который в наибольшей степени ему соответствует, в результате чего может быть получен список объектов, соответствующих данному нейрону. [c.172]

Каждый нейрон может быть изображен на географической карте в месте его расположения. Тем самым обеспечивается наглядное отображение распределения объектов недвижимости. Топологическое соседство дает информацию о том, насколько хорошим прототипом для ближайшего окружения является представленный нейроном объект. Разброс компонент объектов у соответствующего нейрона можно сравнить с расстояниями между нейронами в ближайшем топологическом соседстве. [c.174]

Другим способом сглаживания квантованных значении, сгенерированных СОК является использование группы объектов, организованных в виде портфеля. Наибо лее подходящий нейрон содержит значения компонент каждого объекта, которые затем суммируются и делятся на число объектов в портфеле Слегка различающимся между собой объектам соответствуют значения нейронов, расположенных по соседству или в других подобластях, а для нетипичных объектов вычисляются, воз можно, наилучшие значения. [c.179]

В 1982 году финский ученый Тойво Кохонен (Kohonen, 1982) предложил ввести в базовое правило соревновательного обучения информацию о расположении нейронов в выходном слое. Для этого нейроны выходного слоя упорядочиваются, образуя одно- или двумерные решетки. Т.е. теперь положение нейронов в такой решетке маркируется векторным индексом i. Такое [c.84]

Метод СОК основан на использовании нейронных сетей, обучаемых без учителя. По сравнению с другими нейросетевыми методами (некоторые из которых описываются в работе Дебока (Deboe k, 1994)), требующими, чтобы один или несколько выходов были ассоциированы с одним или более входами, СОК сводит многомерные данные к дву- или трехмерным картам или нейронным решеткам. Алгоритм СОК построен по принципу конкурентного обучения без учителя. Элементы карты, или нейроны, образуют обычно двумерную решетку, т.е. в конечном итоге мы имеем дело с отображением многомерного пространства на плоскости или в трехмерном пространстве. Метод СОК сохраняет топологию данных. Это означает, что СОК объединяет похожие векторы входных данных в рамках одних и тех же нейронов или узлов решетки. Точки, расположенные в пространстве входных векторов близко друг к другу, отображаются в элементах карты, также располагающихся рядом. Таким образом, СОК может служить инструментом для кластерного анализа многомерных данных. СОК обладает также способностью к обобщению. Способность нейронной сети к обобщению означает, что сеть может распознавать или давать характеристику входных данных, которые не встречались ей ранее. [c.81]

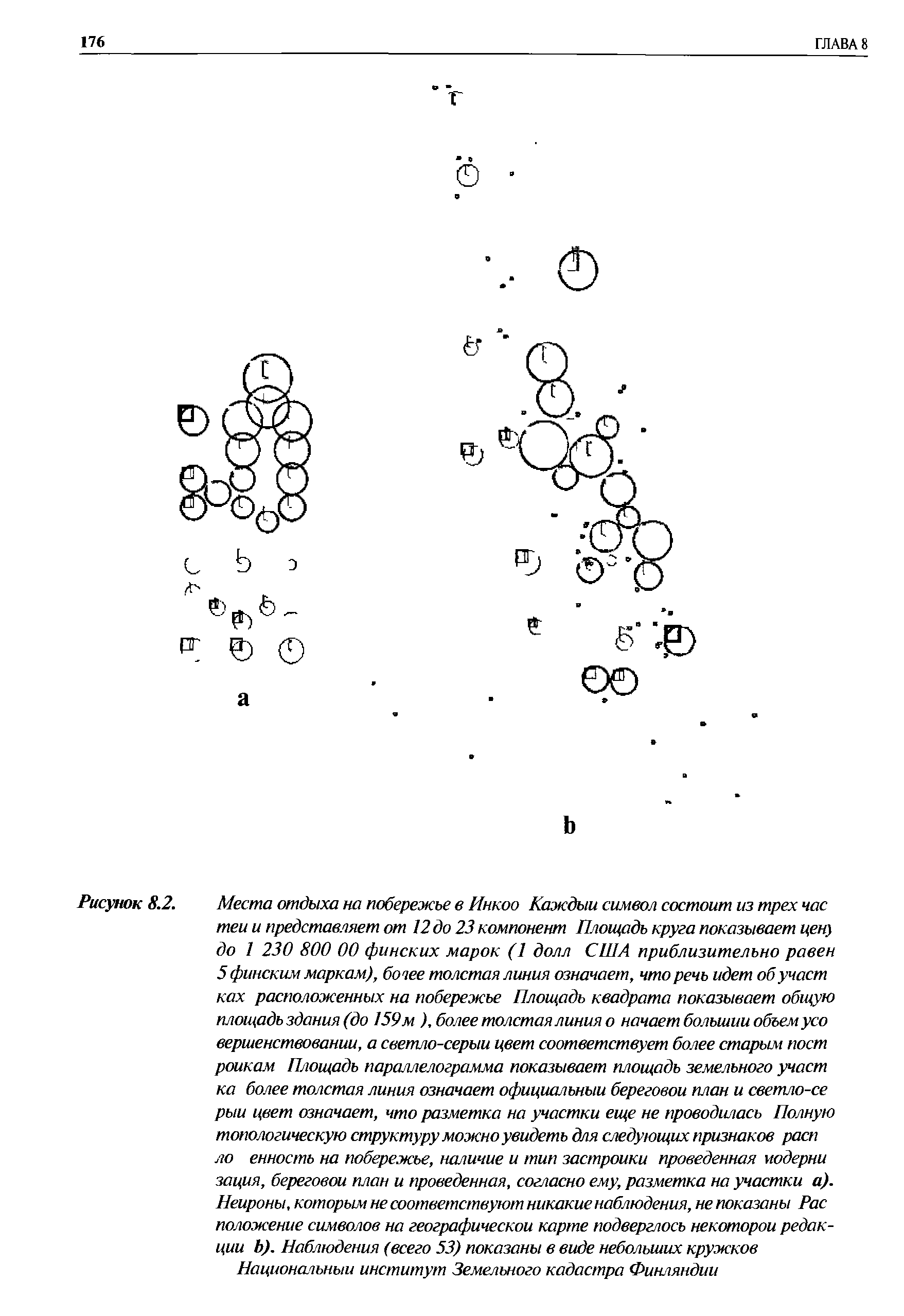

| Рисунок 8.2. Места отдыха на побережье в Инкоо Каждый символ состоит из трех час теи и представляет от 12 до 23 компонент Площадь круга показывает цен) до 1 230 800 00 финских марок (1 доля США приблизительно равен 5 финским маркам), бочее толстая линия означает, что речь идет обучает ках расположенных на побережье Площадь квадрата показывает общую площадь здания (до 159м ), более толстая линия о начает больший объем усо вершенствовании, а светло-серый цвет соответствует более старым пост ройкам Площадь параллелограмма показывает площадь земельного участ ка более толстая линия означает официальный береговой план и светло-се рыи цвет означает, что разметка на участки еще не проводилась Полную топологическую структуру можно увидеть для следующих признаков расп ло енность на побережье, наличие и тип застройки проведенная надерни зация, береговой план и проведенная, согласно ему, разметка на участки а). Нейроны, которым не соответствуют никакие наблюдения, не показаны Рас положение символов на географической карте подверглось некоторой редакции Ъ). Наблюдения (всего 53) показаны в виде небольших кружков Национальный институт Земельного кадастра Финляндии |  |

В будущем значительный прогресс мог бы быть достигнут путем использования нейронных сетей для обработки данных географической информационной системой (ГИС), как это было показано в предыдущей главе. Таким образом, оценщик сможет пегко распознать множество похожих объектов и определить их местоположение на географической карте. В качестве показателя сходства может быть использована ошибка квантования. При необходимости оценщик смог бы также отыскать нейроны, связанные с данными, близкими ко входному вектору или к искомым характеристикам жилья, либо нейроны, расположенные в географической близости к нейрону-победителю . [c.190]

Модели ПНС, в которых фазовые соотношения сигналов зависят только от геометрии сети - длин соединений между нейронами, расстояний между нейронными слоями, конфигурации и взаимного расположения слоев, - называются геометрическими. Модели, в которых они зависят от задержек в синапсах, называются синаптическими. Геометрия сети в них несущественна. Все классы ПНС имеют общую архитектуру, состоящую из четырех слоев слой А - источник (аналог источника опорной волны в голографии) слой В исходных образов, представляемых распределением потенциалов слой С, в котором в результате интерференции сигналов от А и В возникает распределение потенциалов, образующее голограмму образа В слой D, в котором в результате интерференции сигналов от нейронов слоя С, "освещенного" источником А, возникает распределение потенциалов, представляющее восстановленный образ. Степень сходства этого образа с образом В определяет качество восстановления. [c.23]